Una breve premessa: il termine deepfake nasce nel 2017 dal forum Reddit, l’utente deepfakes pubblica in una sezione del sito video pornografici nella quale scambia il volto delle attrici con altre celebrità mediante la tecnologia dei deepfake, basata sull’intelligenza artificiale. In questo articolo, però, il concetto di deepfake non si riferisce solo a questo tipo di video ma più ampiamente a tutti i contenuti multimediali sintetizzati digitalmente con l’aiuto dell’intelligenza artificiale.

Sommario:

Tra reale e virtuale

Nel corso degli ultimi anni abbiamo visto quanto l’intelligenza artificiale sia cresciuta e abbia pervaso quasi ogni aspetto della nostra vita. Non immaginatevi di essere nel film Ex Machina o nelle serie BlackMirror. Parliamo di software di apprendimento automatico avanzato che utilizzano algoritmi comportamentali per adattarsi alle nostre richieste.

Una tecnologia interessante basata sull’intelligenza artificiale e di cui recentemente si è tanto sentito parlare è la tecnologia dei deepfake. Infatti, da qualche anno è la forma di manipolazione digitale più comune e più rischiosa perchè assottiglia molto la linea tra reale e virtuale.

Per quanto sia innovativa e piena di potenzialità e come tutte le invenzioni non intrinsecamente buona o cattiva, se utilizzata con gli scopi sbagliati può provocare danni anche irreparabili. Questi sono dovuti principalmente alla capacità dei deepfake di distorcere la realtà e alla conseguente difficoltà dell’utente di riconoscere il vero dal falso.

La regina sa ballare?

Oggi, cercando su qualsiasi motore di ricerca il termine deepfake ci si imbatte in articoli come quello riportato dal New York Post il cui argomento principale è il messagio di auguri di natale della regina Elisabetta. Vi chiederete cosa abbiano a che fare i deepfake con la regina d’Inghilterra. Beh, la risposta è semplice. Come ogni anno, il discorso di fine anno della regina viene trasmesso sulla BBC, che ne detiene i diritti, ma quest’anno il canale televisivo britannico Channel Four, per ovviare alla mancanza dei diritti, ha creato un deepfake della sovrana.

Ignorando la fonte del video e non leggendone il titolo, a primo impatto pare che la protagonista sia realmente la regina. Ciò che permette di riconoscere il contenuto come un deepfake, tralasciando la prestanza fisica della sovrana e l’assurdità delle parole pronunciate, sono i movimenti del viso che in alcuni momenti risultano artificiali. E in un certo senso lo sono, ma in modo intenzionale. Infatti, i creatori del deepfake hanno voluto sottolineare quanto sia facile nell’era digitale alterare contenuti e diffondere fake news.

Cosa sono i deepfake e come funzionano?

I deepfake sono contenuti multimediali che si basano sull’intelligenza artificiale. Sono creati sovrapponendo e combinando automaticamente immagini, video o suoni esistenti con contenuti originali. Il risultato è la riproduzione di un’immagine o una voce realistica. Parliamo di contenuti multimediali creati in modo automatico perchè generati dal computer senza l’intervento manuale dell’uomo.

Questi contenuti artificiali sfruttano un sistema di reti neurali profonde che sono alla base del deep learning, ovvero dell’apprendimento automatico delle macchine. Per poter creare i deepfake è necessario utilizzare degli algoritmi che vengono appresi dalla macchina e che si basano su una enorme quantità di dati per funzionare correttamente. Maggiori sono i modelli utilizzati per istruire la macchina e più realistico sarà il risultato.

Se volete un esempio di quanto sembrino vere le immagini create con questa tecnologia non serve altro che visitare This Person Does Not Exist e per ogni volta che ricaricherete la pagina vi apparirà una persona che non esiste ma che è stata digitalmente e artificialmente creata. Se invece volete mettere alla prova la vostra bravura nello scovare quali immagini sono costruite da software di intelligenza artificiale e quali sono vere allora vi consigliamo il sito Which Face is Real (non credete che sia facile, per ogni 10 volti ne ho sbagliati 5!)

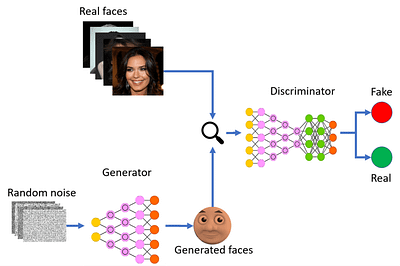

Le reti neurali che permettono la creazione di deepfake si chiamano GAN o generative adversarial networks e sono state inventate nel 2014 da Ian Goodfellow – se siete interessati all’aspetto tecnico, vi consiglio di leggere l’articolo scritto da Goodfellow e altri in seguito alla conferenza sui sistemi neurali di elaborazione dell’informazione del 2014. Le reti GAN si suddividono in due tipi:

- generatore, algoritmo che genera le immagini e che attinge i dati da un dataset.

- classificatore, algoritmo che apprende e classifica le immagini in vere o false.

I due algoritmi poi entrano in competizione tra loro, il generatore crea immagini umane mentre il classificatore le riconoscerà come reali o meno. Questo permette di generare immagini sempre più realistiche, infatti la tecnologia GAN viene utilizzata per modificare singole parti del volto o ricostruire digitalmente un corpo.

Creare il proprio deepfake

Fino a poco tempo fa la realizzazione di video in cui vi era uno scambio di volto era un lavoro costoso e complicato tipicamente svolto per la produzione di film con la tecnica del CGI, computer generated imagery. Ora, invece, esistono applicazioni per desktop e per mobile che permettono a tutti di creare il proprio deepfake. Per esempio FakeApp, un’applicazione su desktop sviluppata anonimamente da un utente della piattoforma Reddit nel 2018. Oppure, Reface che potete facilmente scaricare sul vostro telefono per scambiare il vostro volto a quello di attori, cantanti e celebrità per provare l’emozione di essere all’interno del vostro film o video musicale preferito.

Ho provato in prima persona l’applicazione FaceSwap e sinceramente il risultato ha superato le mie aspettative. Nonostante sia chiara l’opera di manipolazione fatta sul video è incredibile la velocità con cui questo è stato prodotto e soprattuto la sua realisticità. Quindi eccomi nei panni di Kate Winslet in un mashup di scene iconiche del film Titanic.

La diffusione dell’informazione in rete

Per comprendere come i deepfake diventino virali e causino, tra svariati problemi, la disinformazione dobbiamo chiarire come si veicola l’informazione online. Questa si diffonde democraticamente tra gli utenti, una persona può teoricamente avere la stessa capacità di condivisione dell’informazione che ha una fonte mediatica credibile. In quanto il web è formato da reti di persone, e quando il contenuto pubblicato da un utente viene ricondiviso da un altro crea una catena di condivisioni tra le reti degli utenti da renderlo virale.

Tre fenomeni che caratterizzano la condivisione di informazione in rete

- Information cascade dynamic, dinamica per la quale le informazioni si diffondono come una cascata, ovvero senza alcun controllo. É un fenomeno che avviene perchè le persone ad un certo punto della catena di condivisione smettono di prestare attenzione alla veridicità di ciò che condividono supponendo che qualcuno abbia svolto il lavoro di fact-checking prima di loro. Questo accade perchè non siamo onniscienti e a un certo punto ci dobbiamo basare su ciò che gli altri conoscono dandolo per vero e accertato.

- Human attraction to negative and novel information, l’essere umano è attratto alle notizie soprattutto quando sono negative. Siamo propensi a condividere con gli altri ciò che non conoscevamo prima e che potrebbe avere risvolti negativi sulla nostra vita. Inoltre, le notizie negative e quelle relative a stimoli come il sesso e la violenza, al contrario di quelle positive, sono più memorabili.

- Filter Bubble, una dinamica (non esclusiva del web) per cui ci circondiamo di persone che condividono con noi credenze e valori. Soprattutto sui Social Media il fenomeno aumenta perchè gli algoritmi alla base di queste piattaforme ci mostrano per lo più contenuti a cui siamo interessati e che potremmo condividere con altri. Questo crea delle bolle di informazioni filtrate sulla base dei nostri interessi e di ciò che crediamo vero.

I deepfake nelle mani delle persone sbagliate

I think that technologies are morally neutral until we apply them. It’s only when we use them for good or for evil that they become good or evil

Credo che la tecnologia sia eticamente neutra finchè non la applichiamo. Ed è solo quando la usiamo per il bene o per il male che diventa buona o cattiva – William Gibson.

Come disse William Gibson, la tecnologia di per sè non è positiva o negativa ma il suo utilizzo può causare danni o benefici a seconda di chi la ha tra le mani. Parliamo di come i deepfake possano causare gravi ripercussioni sulla nostra società se a monte manca l’attenzione dell’utente e le buone intenzioni dei creatori. Non andremo ad analizzare solo i casi reali ma anche le possibili problematiche che una cattiva gestione di questa tecnologia può provocare.

Disinformazione e distorsione delle realtà

Sappiamo tutti quanto facilmente dilaghino le fake news e la disinformazione sul web, quanto le notizie non veritiere e non accertate influenzino le persone e quanto venga sfruttata l’ignoranza dell’utente medio sul web per renderle virali.

Tuttavia, dobbiamo disitnguere tra le notizie scritte e i deepfake, le prime sono più semplicimente distinguibili tra vere e false. Infatti, tendenzialmente cerchiamo una fonte attendibile che riprenda quella notizia e ci informiamo riguardo alla sua veridicibilità leggendola attentamente.

Non è lo stesso per i deepfake che più difficilmente vengono smentiti in quanto stanno diventando sempre più realistici. Per anni abbiamo considerato i contenuti audiovisivi come una fonte di informazione certa, difficili da manipolare, e la possibilità che tutti possano alterare la realtà, spaventa. Perchè, fino ad ora, i nostri sensi sono stati una fonte certa per discernere a cosa credere e a cosa no, e se questo viene meno ci troviamo senza strumenti per essere informati in modo corretto.

Le spaventose conseguenze dei deepfake

Vi chiedo, ora, di fare uno sforzo immaginativo nemmeno tanto grande: fingete di essere in periodo elettorale e di avere già la idee chiare su chi votare, quando aprite Facebook o qualunque altro social media. Vi si palesa nel feed un video deepfake che non riconoscete come tale. Sta parlando il candidato che avete deciso di votare e sta esclamando qualcosa di assolutamente provocatorio e non condivisibile ma comunque credibile.

Probabilmente (me lo auguro), una parte di voi andrà a cercare la fonte del video, se effettivamente qualcun altro lo riporta e se ne stanno parlando siti affidabili. Non trovandola, lo catalogherà come falso, nonostante l’incredibile realisticità del video. Tuttavia, altri lo vedranno e non accertandosi della sua veridicità lo condivideranno sul loro feed innescando la reazione a catena del processo di disinformazione che conosciamo bene. Probabilmente rovinando la reputazione del candidato e la possibilità di vincere le elezioni.

Per quanto sia una situazione lontana dalla realtà, perchè ancora non è avvenuta, non è così impensabile pensare che possa capitare. La BBC riporta, ad esempio, che durante la campagna elettorale per la posizione di Primo Ministro in Gran Bretagna, un deepfake raffigurante i due candidati Boris Johnson e Jeremy Corbyn ha fatto il giro del web. L’agenzia che lo ha messo a punto ha voluto denunciare la possibilità dei deepfake di minare la democrazia.

Le situazioni in cui un deepfake può provocare una cascata di disinformazione e avere conseguenze pericolose sulla società sono tantissime. Potrebbero essere diffusi per alimentare le tensioni tra la popolazione e le istituzioni, la sicurezza e la polizia. Oppure, screditare ideologie e verità scomode o semplicemente contrarie al proprio credo.

Inoltre, vorrei sottolineare come questa tecnologia possa causare anche l’effetto contrario, ovvero il ritenere false cose che in realtà sono vere. Eistono già teorie complottiste per cui le prove di avvenimenti come la caduta delle torri gemelle o l’allunaggio sono considerate artificialmente generate. Con i deepfake diventa ancora più facile tirare acqua al proprio mulino dando credibilità alle proprie ideologie.

Sfruttamento dell’identità di una persona

Come vi ho anticipato all’inizio dell’articolo, i primi deepfake a fare la loro comparsa sul web sono stati video pornografici pubblicati sull’aggregatore di notizie Reddit nel 2017. Nella sezione r/deepfakes del portale, l’utente DeepFakes condivideva i propri deepfake amatoriali che in questo caso erano video di pornostar i cui volti erano stati scambiati con altre celebrità o altre persone.

A questa sezione del sito erano iscritti circa 100,000 utenti e questo disgustoso utilizzo della tecnologia ha iniziato a prendere piede. Si potevano vedere video in cui personaggi come Michelle Obama, o meglio il suo doppelganger digitale, si spogliavano davanti alla telecamera o attrici come Gal Gadot in situazioni a dir poco sconvenienti.

Poi gli iscritti al portale hanno inizito a chiedere consigli su come scambiare il volto delle attrici, non più solo con celebrità ma con i volti di ex-fidanzate e fidanzate inconsapevoli. Questo ha innescato un meccanismo di revenge porn di cui nell’ultimo periodo si è parlato tanto in relazione a piattaforme di diffusione di informazione come Telegram.

Fortunatamente i gestori della piattaforma Reddit hanno chiuso la sezione che ha diffuso per la prima volta i deepfake di questo genere. Al suo posto ora c’è r/SFWdeepfakes dove gli utenti pubblicano tutorial, consigli e video deepfake totalmente safe for work ovvero non pornografici e spesso umoristici.

Ovviamente per produrre questo genere di contenuto manca il consenso della persona scambiata che l’utente inserisce in un contesto in cui non appartiene per la propria e altrui gratificazione.

Dignità violata

Il grave problema, oltre al deplorevole comportamento tenuto da questi soggetti nello sfruttare l’immagine di una persona in termine sessuali, sono le ripercussioni che queste situazioni possono avere sulla vittima: oltre al trauma psicologico di vedersi coinvolte in atti sessuali a cui non si è mai partecipato, si deve aggiungere la violazione della propria sfera intima, l’invasione della privacy, le conseguenze sulla propria immagine lavorativa e sulla propria reputazione.

Non è una novità il fatto che il revenge porn e in generale la diffusione non consensuale di video pornografici di donne abbia conseguenze gravi sulla loro immagine e sulla loro reputazione pubblica. Lo abbiamo visto di recente con il caso dell’insegnante di asilo licenziata per la diffusione da parte dell’ex-fidanzato di un suo video intimo. E ne è stato tanto parlato con il caso di Tiziana Cantone che si è tolta la vita in seguito all’attenzione che aveva ricevuto per un suo video pornografico.

Potete benissimo immaginare le conseguenze che subirebbe una dipendente se un suo deepfake pornografico dovesse circolare. Se poi finisse tra le mani di un datore di lavoro che non è in grado di capire se è vero o falso allora sarebbe disastroso per la sua posizione lavorativa. E questo porterebbe con sè una valanga di ripercussioni gravissime sulla sua persona.

Perdita della reputazione

Le conseguenze dei video deepfake non riguardano solamente la sfera intima e sessuale di una persona ma possono riguardare più ampiamente la sua immagine pubblica. Cosa succederebbe se qualcuno dovesse pubblicare un deepfake in cui siete presenti voi, intenti a distruggere una proprietà privata, in stato di ebbrezza o magari ripresi mentre esclamate frasi razziste o sessiste?

Le conseguenze sulla vostra sfera personale e sui rapporti che nel tempo avete costruito sarebbero molto gravi soprattutto se non doveste riuscire a smentirlo per tempo. E anche nel caso in cui riusciste, una volta che una reputazione è macchiata sul web è difficile ripristinarla. Ci sarebbero ripercussioni su un vostro futuro lavoro perchè sappiamo quanto la ricerca di una persona sul web sia parte fondamentale della selezione per un impiego.

Cyberbullismo e Cybercrime

La creazione di deepfake con soggetto persone intente in situazioni compromettenti, illegali o semplicemente malviste dalla società ha tra le sue conseguenze il cyberbullismo. Le persone raffigurate nel video possono essere denigrate, prese di mira o addirittura minacciate e ricattate.

Immaginatevi nei panni di un ragazzino adolescente che vede in un video un altro ragazzo ripreso in qualcosa di imbarazzante. Al posto del volto del soggetto trova il suo viso. Pensate se questo contenuto venisse diffuso e visto da centinaia di persone, che effetto potrebbe avere su di voi? Paghereste qualcuno che vi minaccia pur di chiudere la faccenda? Non saprei rispondere a queste domande perchè mi sembrano situazioni molto lontane, ma è bene sapere quanto queste possibilità siano concrete e non solo il frutto di una fervida immaginazione.

Inoltre, si potrebbero utilizzare i deepfake per attività criminali come lo spoofing, il phishing e il ransomware. Tutti reati di furto di informazione mediante la falsificazione dell’identità digitale altrui. Vi è, poi, il pericolo che i deepfake vengano utilizzati per ingannare i sistemi di sicurezza biometrici. Ancora una volta vi chiedo di immedesimarvi in una situazione per voi impensabile ma molto vicina. Immaginate di ricevere da un vostro amico un messaggio vocale che vi invita a inviargli una somma di denaro perchè in estremo bisogno. Cosa fareste? Buona parte di voi non avrebbe ripensamenti nel soddisfare la sua richiesta, eppure potrebbe essere una truffa portata a termine con un deepfake.

E per chi pensa sia impossibile, ricredetevi! Una simile vicenda è accaduta veramente. Secondo il Wall Street Journal in Inghilterra un truffatore ha utilizzato un deepfake vocale del capo di un’azienda per ingannare il CEO nell’inviargli €220,000. É la prima volta che una truffa si attua mediante l’intelligenza artificiale.

Una carrellata di speranza per gli amanti dei deepfake

Per non deprimervi e per non farvi perdere ogni speranza nell’utilizzo positivo della tecnologia, abbiamo stilato una lista di situazioni in cui i deepfake hanno conseguenze positive per la società. Grazie allo sviluppo del data science e dell’intelligenza artificiale sono emerse nuove idee e capacità mai pensate prima d’ora. Infatti, se usata eticamente, l’intelligenza artificiale crea possibilità e opportunità per tutti, indipendentemente da chi sono e quali difficoltà hanno.

Pubblicità e marketing

Partiamo con l’utilizzo più pratico e soprattutto più attuale dei deepfake per scopi benevoli. A causa della pandemia da Covid-19 scoppiata nel Marzo dell’anno passato molte aziende si sono ritrovate senza possibilità di registrare e produrre spot. Alcune agenzie pubblicitarie hanno risolto il problema con i deepfake.

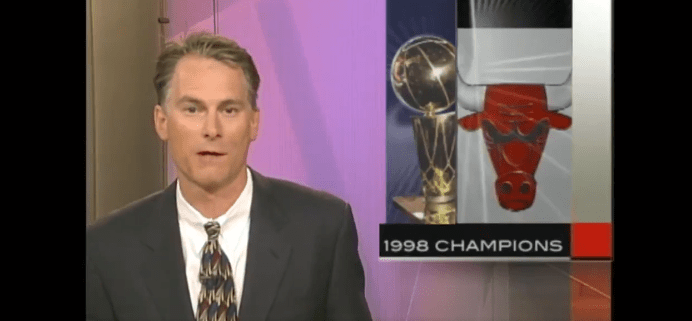

Come riporta il New York Times l’azienda di assicurazione auto State Farm durante un episodio di The Last Dance (docu-serie prodotta da ESPN e visionabile su Netflix) ha mandato in onda uno spot deepfake. Nel video viene ritratto il celebre presentatore sportivo Kenny Mayne in una sua versione più giovane, intento a celebrare la vittoria dei Bulls, la squadra di Micheal Jordan, al campionato.

Nella clip, ambientata alla fine degli anni ’90, il giovane Mayne si rivolge al pubblico e esclama con fare certo che la vittoria celebrata sarà soggetto di un documentario di ESPN chiamato The Last Dance e che il video in questione sarà utilizzato per una pubblicità.

Per alcuni è uno spot inquietante e ingannevole, per altri ha alleggerito la pesantezza della quarantena. Per alcune agenzie pubblicitarie, come la tedesca Deutsche, è fondamentale avvisare gli spettatori di star visionando un contenuto che non è completamente vero per non farli sentire ingannati.

Comunque, qualunque sia il vostro pensiero a riguardo è innegabile che sia un ottimo prodotto multimediale e soprattutto realizzato con estrema verosomiglianza.

Accessibilità

Secondo il consorzio W3C l’accessibilità web è una delle caratteristiche più importanti che un sito web o un’applicazione debbano avere. Infatti, un sito web accessibile permette a persone con disabilità di accedere a qualsiasi contenuto con qualsiasi dispositivo. I maggiori destinatari dell’accessibilità sono coloro che hanno difficolta di vista, udito e comprensione.

Sicuramente gli strumenti più utili, al giorno d’oggi, per rendere il web accessibile, sono basati sull’intelligenza artificiale. In particolare, i deepfake possono rendere questi strumenti ancora più intelligenti, convenienti e personalizzabili aumentando l’autonomia delle persone in difficoltà. Alcune applicazioni di deepfake e intelligenza artificiale per l’accessibilità sono:

- seeing AI, un’applicazione Microsoft che mediante la fotocamera del telefono narra ai non vedenti il mondo che li circonda; permette di leggere testi; documenti; riconoscere prodotti; persone e la valuta di diverse monete. Una svolta se si pensa che altrimenti queste persone avrebbero uno strumento in meno per essere autonomi nella vita di tutti i giorni. Una simile applicazione alla precedente è Google Lookout, è un prodotto Google che sfrutta l’intelligenza artificiale come strumento di accessibilità per i non vedenti.

- VOCALiD, che per chi soffre di ALS, sclerosi laterale amiotrofica, e per chi non ha una voce è uno strumento estremamente potente. Mediante l’intelligenza artificiale e una voicebank di frasi che volontari hanno caricato sulla piattaforma crea personalità vocali uniche per qualunque device. In questo modo, lo strumento del text-to-speech diventa assolutamente personalizzato dando una voce unica a chi non ce l’ha.

Istruzione

Sappiamo bene quanto sia diventata importante la tecnologia nelle aule scolastiche e quanto nell’ultimo periodo sia stata fondamentale per assicurare che tutti potessero accedere all’istruzione. Oltre però ai video, alle immagine e alla musica, l’utilizzo dei deepfake ha la potenzialità di trasformare le lezioni in innovative ed avvincenti, ciò che gli studenti vorrebbero.

I contenuti multimediali artificialmente generati possono, ad esempio, riportare in vita personaggi storici che parlando direttamente alla classe avrebbero un effetto diverso rispetto alla lettura su un testo o alla visione di un documentario. Se pensate che stia impazzendo e che una possibilità simile sia solo possibile nei film di fantascienza, vi sbagliate.

In questo video potete finalmente ascoltare il potente discorso sulla fine delle guerra fredda che l’ex presidente statunitense JFK non ha mai potuto pronunciare a causa del suo assassinio nel 1963. Vi chiederete come sia possibile che un discorso mai pronunciato sia ascoltabile adesso. La risposta si trova, ovviamente, nei deepfake.

CerecProc, azienda scozzese che si occupa di advanced speech synthesis, assieme a Rothco, agenzia pubblicitaria irlandese, hanno collaborato per ricreare in modo realistico la voce del vecchio presidente. In otto settimane il team ha analizzato 831 segmenti di discorsi del presidente e ha sintetizzato la sua voce dividendo le registrazioni in 116,777 unità fonetiche. Hanno poi aumentato il noise di sottofondo per rendere il prodotto omogeneo.

È il primo audio speech interamente sviluppato a partire da un dataset e in intelligenza artificiale, il cui risultato è un discorso assolutamente realistico di 21 minuti e 48 secondi.

Intrattenimento

L’alterazione digitale di contenuti multimediali non è una novità, Hollywood lo fa da tempo immemore con tecnologie costose come il CGI, VFX e SFX. Queste creano mondi artificiali completamente credibili e riproducono personaggi reali senza che questi siano veramente presenti. Lo vediamo nella scena che vi propongo del film Forrest Gump dove il protagonista parla con figure storiche ormai morte da tempo, come JFK.

Però, come abbiamo detto queste tecnologie sono estremamente costose e non tutti possono permettersele. Ed è qua che entrano in gioco i deepfake, un’ottima alternativa a questi strumenti perchè a costo ridotto permettono di trasformare la finzione in realtà.

Sono, infatti, utilizzati da creatori indipendenti su piattaforme quali YouTube per realizzare perlopiù parodie di film celebri. Al posto del volto dell’attore protagonista viene trasposto un altro personaggio famoso. E se vi foste mai chiesti come sarebbe Mr. Bean se il protagonista non fosse interpretato da Rowan Atkinson ma dal nostro Renzi non cercate oltre.

Arte e cultura

Per quanto riguarda l’arte nel senso più comune del termine, i deepfake sono un ottimo ausilio e strumento per i musei che li possono sfruttare per creare esibizioni innovative ed avvincenti.

I believe in general in death, but in the death of Dalì, absolutely not.

Credo nella morte in generale, ma nella morte di Dalì assolutamente no. – Salvador Dalì.

Dalì ha dato, con questa citazione, un’idea incredibile al suo omonimo museo a St. Petrsbourg in Florida che nel 2019 ha dato vita a alla surreale esibizione Dalì Lives. L’artista, morto ormai da trent’anni, è stato riportato in vita grazie a un deepfake di dimensione reale con cui i visitatori potevano interagire.

Il deepfake in questione è stato realizzato prendendo da un archivio di video interviste dell’artista oltre 6,000 fotogrammi e impiegando più di 1,000 ore di machine learning per far apprendere agli algoritmi il volto di Dalì. Successivamente le sue espressioni facciali sono state sovraimposte su un attore, la sua voce invece è stata doppiata da una persona in grado di imitarne l’accento particolare, un insieme di francese, spagnolo e inglese.

Libera espressione e informazione

Non è da sottovalutare la potenzialità dei deepfake come strumento per salvaguardare l’anonimato di giornalisti e attivisti per i diritti umani. Si può usare l’intelligenza artificiale per creare video e audio vocali per denunciare situazioni che altrimenti non verrebbero palesate perchè troppo rischiose. Sicuramente è uno degli utilizzi più potenti che si possono fare dei deepfake, dando una voce a chi è troppo spaventato per esprimersi e rendendo irriconoscibili i volti di chi deve proteggere la propria privacy.

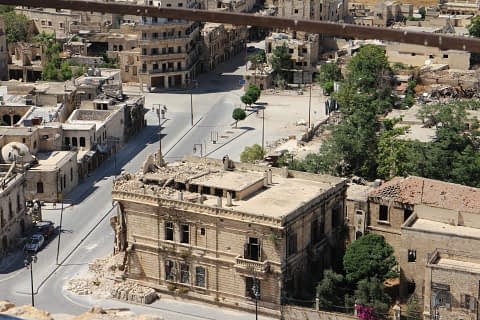

Può l’intelligenza artificiale insegnarci l’empatia?

È la domanda alla base del progetto Deep Empathy dell’UNICEF che mediante l’intelligenza artificiale studia le caratteristiche dei quartieri Siriani afflitti dal conflitto della guerra e lo riproduce su altre città del mondo. L’utente, entrando nel sito può caricare un’immagine della propria città e vederla come se fosse parte del conflitto siriano. Lo scopo del progetto è stimolare l’empatia del pubblico con la situazione siriana e avvicinarlo a un mondo che vede come lontanissimo, immergendo il soggetto in una realtà che potrebbe essere la sua.

Amplificare la propria voce e aumentare il proprio pubblico

Perchè non utilizzare i deepfake per amplificare il raggio di azione di un messaggio importante? È ciò che hanno fatto alcuni personaggi influenti e alcune organizzazioni per aumentare il proprio pubblico in ascolto. É il caso della campagna Malaria must die in cui il protagonista è David Beckham che grazie all’intelligenza artificiale e al software per deepfake creato dalla startup Syneshesia si è rivolto al pubblico in nove lingue diverse.

Altro caso interessante, simile per certi versi al Malaria Must Die, riguarda il deepfake del presidente del partito indiano Bharatiya Janata Party (BJP), Manoj Tiwar, diventato virale nel febbrario dell’anno passato. Il video originale vede il politico parlare in Inglese, mentre il video alterato lo raffigura mentre parla in Haryanvi, il dialetto Hindi degli elettori da cui voleva ottenere il voto. È la prima volta che un partito politico utilizza un deepfake per la propria campagna elettorale e molto probabilmente non sarà l’ultima.

I deepfake, poi, possono essere utilizzati dagli influencer e dai brand per ampliare il loro pubblico e lanciare messaggi personalizzati. Esistono anche influencer sviluppate interamente con l’intelligenza artificiale come Lil Miquela che ormai ha un following incredibile sui suoi social media. Recentemente l’influencer digitale è stata criticata insieme al brand Calvin Klein per aver partecipato a uno spot provocatorio in cui la teenager bacia la supermodella Bella Hadid. Il motivo dietro alla critica sarebbe il queerbating che secondo alcuni sarebbe alla base della campagna. Essendo, infatti, la modella rinomatamente eterossessuale non è stato visto di buon occhio il suo bacio virtuale con Lil Miquela, inteso come un modo per attirare l’attenzione da parte del brand.

Innovazione nell’innovazione

Alcuni scenari in cui i deepfake rappresentano una vera innovazione e nella quale hanno un impatto incredibilmente positivo sono il campo medico e il campo della moda.

In ambito medico

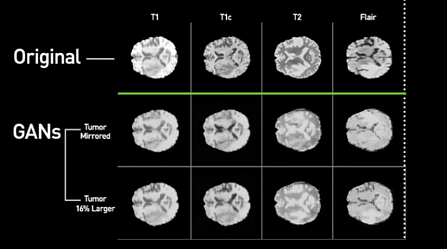

Abbiamo già stabilito che attualmente i sistemi di intelligenza artificiale per funzionare correttamente necessitano di un’elevatissima quantità di dati. Tuttavia, non è sempre possibile raccoglierli per questioni di privacy o per la rarità di una malattia. Per i ricercatori che vogliono utilizzare l’intelligenza artificiale per riconoscere determinate condizioni mediche questo è un problema grave.

I ricercatorori di NVIDIA, MGH & BWH Center for Clinical Data Science e the Mayo Clinic hanno trovato una soluzione nei deepfake. Infatti, mediante i GAN sono riusciti a sintetizzare immagini mediche che non sono distinguibili da quelle reali e moltiplicare dunque i dati a disposizione dei ricercatori. Nella ricerca sono state create delle immagini sintetiche di scansioni MRI di un tumore al cervello per far apprendere gli algoritmi a riconoscere un determinato tipo di cancro.

Purtroppo però anche questa soluzione presenta un problema, ovvero la potenza richiesta ai computer e il costo elevatissimo per la riproduzione di questi deepfake. Questo perchè le immagini create hanno un’altissima risoluzione. Ma l’essere umano ha tanta inventiva e incredibili risorse e riesce sempre a trovare un’alternativa quando qualcosa non pare possibile. I ricercatori dell’università di Lubeck hanno proposto un nuovo approccio alla questione e hanno diviso in stadi il processo, in modo da renderlo meno intensivo: i GAN prima generano immagini in risoluzione bassa e poi creano i dettagli nella giusta risoluzione, una piccola sezione alla volta ottenendo immagini ad alta risoluzione con un potenza richiesta decisamente più bassa.

Nella moda

I deepfake in questo campo sono utilizzati dai brand per aumentare il valore dei loro prodotti andando a creare un rapporto diretto con il cliente. Infatti, mediante i deepfake permettono di trasformare il cliente in un modello permettendogli di provarsi virtualmente e comodamente i prodotti e gli accessori del brand.

Un’applicazione innovativa in questo senso è Superpersonal che mediante l’intelligenza artificiale cattura il volto dell’utente e i suoi comportamenti espressivi e li combina a un corpo approssimativamente rappresentativo del cliente, come se fosse la sua versione-modello. L’applicazione è stata fondata da Yannis Konstantinidis, fondatore dello studio di animazione londinese Nomint e il cui scopo è ridefinire il product placement della moda.

Un altro utilizzo interessante dei deepfake in questo campo riguarda la possibilità di inserire l’utente direttamente nella pubblicità del brand, andando a personalizzare totalmente l’esperienza di marketing – non è un futuro tanto lontano se si pensa che Gucci nel 2018 ha collaborato con l’app di messaggistica Genies per permettere agli utenti, non solo di replicarsi e clonarsi in una versione digitale di loro stessi, ma anche di indossare virtualmente 200 repliche dei prodotti del suo brand.

Riconoscere i deepfake e combatterli

Sebbene inizialmente i deepfake non siano stati presi seriamente, da tempo le istituzioni, i social media e i ricercatori hanno iniziato a riconoscere in questa tecnologia un pericolo reale e hanno cercato delle soluzioni pratiche per combatterlo:

- Microsoft ha sviluppato uno strumento per riconoscere i deepfake. Il software in questione analizza le foto e i video e rilascia un punteggio in relazione alla possibilità che si tratti di un’immagine vera o falsa.

- Nel 2019 è nata la Deepfake Detection Challenge da una collaborazione di Facebook, Microsoft, la Partnership on AI’s Media Integrity Steering Committee e di ricercatori. Questa sfida aperta al pubblico ha lo scopo di spingere i ricercatori del mondo a creare delle tecnologie innovative per il riconoscimento dei deepfake.

- Facebook, Twitter e TikTok hanno vietato la ricondivisione e la pubblicazione di deepfake che possono ingannare gli utenti nel pensare che un soggetto abbia detto qualcosa che non ha detto.

- Il governo statunitense sta supportando economicamente la ricerca per la creazione di nuovi algoritmi in grado di riconoscere i deepfake.

- Alcuni ricercatori hanno sviluppato una rete neurale, XceptionNet, in grado di riconoscere il 99% dei deepfake (se siete appassionati vi consiglio la lettura integrale dell’articolo!)

Un ultimo pensiero

Purtroppo, benchè esistano soluzioni concrete alle conseguenze negative dei deepfake, queste non funzioneranno fino a che non ci sarà una corretta educazione e formazione degli utenti online.

I deepfake non sono altro che la rappresentazione di un problema ben più grande che si può risolvere solo insegnando alle nuove generazioni come informarsi ed educarsi. Bisogna sempre cercare di capire da dove provengono le informazioni che leggiamo e che vediamo. Dobbiamo porci domande sulla veridicità dei contenuti che troviamo. Dobbiamo sempre assicurarci che condividendo un contenuto non si vada ad aumentare il processo di disinformazione e la cascata di informazioni false tipiche del web.

E voi, state dalla parte del problema o della soluzione?

Snow J. (2018). Deepfakes for good: Why researchers are using AI to fake health data. Fast Company

Chandler S. (2020). Why Deepfakes Are A Net Positive For Humanity. Forbes

Baron K. (2019). Digital Doubles: The Deepfake Tech Nourishing New Wave Retail. Forbes

Banks A. (2018). What are Deepfakes & why the future of porn is terrifying. High Snobiety

Lane M. (2020). Responsible Innovation: The Next Wave of Design Thinking. Medium

Chen A. (2019).This startup claims its deepfakes will protect your privacy. MIT Technology Review

Colaner N. & Quinn. M. J. (2020) Deepfakes and the Value-Neutrality Thesis. Seattle EU

Mach J. (2019) Deepfakes: The Ugly, and The Good. Towards Data Science

Lee D. (2019) Deepfake Salvador Dalí takes selfies with museum visitors. The Verge

Cole S. (2017). AI-Assisted Fake Porn Is Here and We’re All Fucked. VICE

Signorelli D. (2019). L’invasione dei deepfake: tutti quelli di cui forse non vi ricordate. Wired